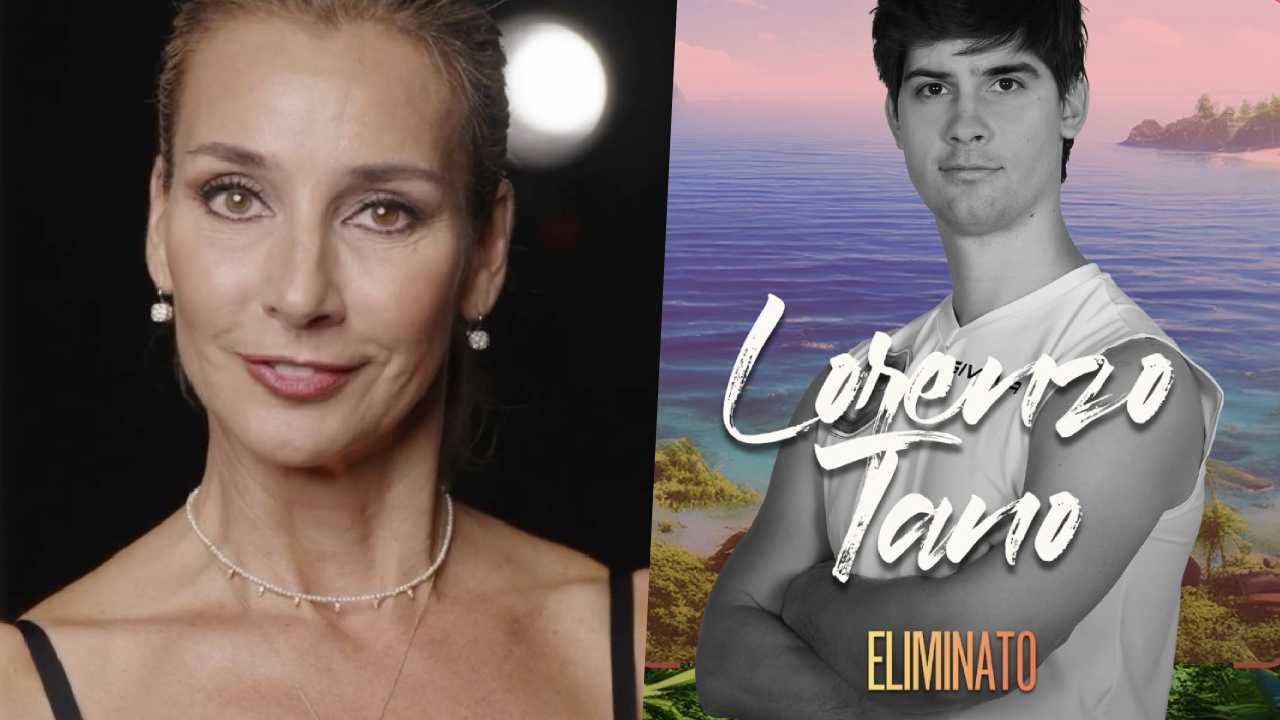

“Le mie frasi del tg manipolate per diffondere disinformazione”. TvBlog intervista la giornalista Rai Silvia Sacchi dopo il video fake sui vaccini

Il volto di Silvia Sacchi è stato usato in un video fake circolato in rete e in cui si parlava dei rischi causati dai vaccini Covid.

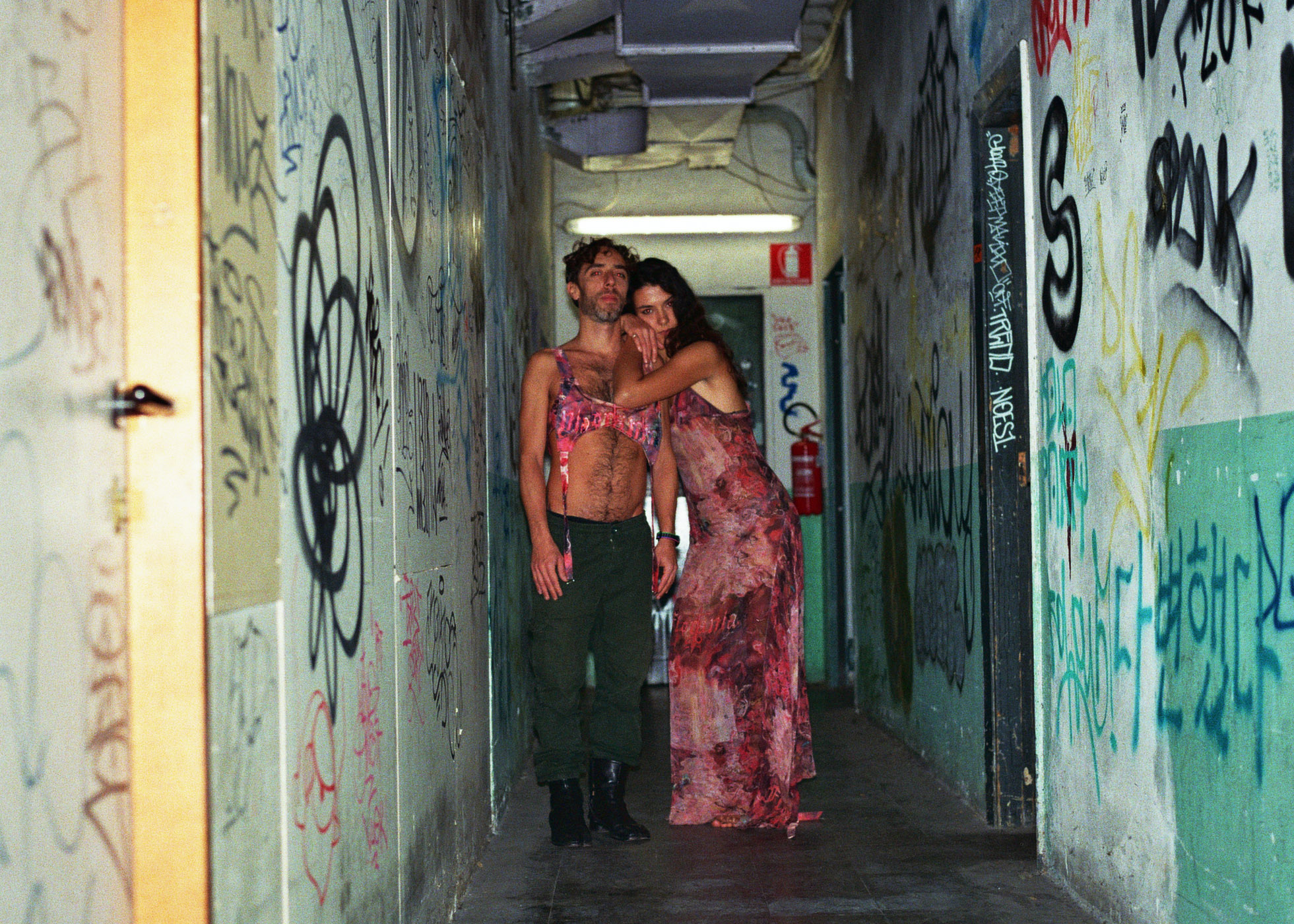

La giornalista Silvia Sacchi e il farmacologo Silvio Garrattini sono stati i protagonisti di un deepfake finalizzato a promuovere teorie anti-vaccino Covid e a vendere una pillola no vax online. Nella clip – condivisa dalla storica collaboratrice Rai sui social – si vede una “finta” Sacchi durante la conduzione del tg. “Chiunque abbia ricevuto il vaccino contro il Covid è in pericolo di vita“, recita il video creato interamente con l’intelligenza artificiale. TvBlog ha intervistato la giornalista che, a proposito di quanto accaduto, dice: “La tecnologia va utilizzata per andare verso un futuro più sostenibile ma così facendo stiamo sbagliando strada“.

Come si è sentita nel vedere la sua immagine manipolata in un video che diffonde disinformazione su un tema così delicato come i vaccini anti Covid-19?

Mi sono sentita violata in quella che è la mia professione. Già quando lavoravo a SkyTg24 avevo ben chiaro quale fosse il mio ruolo: dare notizie agli italiani con l’obiettivo di essere autorevole e credibile. Mi sono quindi sentita toccare in questo aspetto di credibilità, ed è stato come infrangere il mio lavoro.

Si trascorrono anni – tra scuole e università – a formarsi, prepararsi e dare il massimo, ma attraverso queste tecniche subdole e fraudolente l’immagine umana – che in questo caso era la mia – viene sostituita da una creata dall’intelligenza artificiale. Questi esperimenti sono sicuramente la deriva. Se queste sono le premesse, i filmati che troveremo online nel corso dei prossimi anni saranno sempre più perfetti e indistinguibili.

Un falso del genere che ruba l’immagine di un giornalista può far dire qualsiasi cosa a dei professionisti credibili e che hanno costruito negli anni la propria autorevolezza. Questa rappresenta una minaccia molto importante che dobbiamo arginare. La tecnologia va utilizzata per andare verso un futuro più sostenibile, per trovare delle cure per dei mali incurabili; è importante che si possa pian piano usare l’intelligenza artificiale verso il buono, ma così facendo stiamo sbagliando strada. Bisogna capire come tutelarsi da queste situazioni, anche se ancora non so se ci siano gli strumenti giusti per farlo.

Quando e come si è accorta del falso contenuto?

Domenica mattina (11 maggio n.d.r.) un collega mi ha mandato un link chiedendomi se fossi davvero io in quel video.

Quali sono, secondo lei, i rischi più gravi legati alla diffusione di contenuti deepfake nel campo dell’informazione e del giornalismo?

Il mio più grande timore è che questi contenuti vadano a proporre sempre soluzioni non vere, in questo caso pillole magiche contro i vaccini Covid. Vengono diffuse spesso delle strategie false contro un male falso e il vero rischio è che ci siano quindi dei reati molto grandi come la diffusione e l’istigazione all’acquisto di prodotti veicolati come miracolosi. La cosa più grave è che le persone ci credono e comprano.

Ha già avuto modo di confrontarsi con altri colleghi vittime di casi simili, come Valentina Bisti?

Al momento no, ma mi piacerebbe tanto poter parlare con lei, che ha dato una notizia così rara come quella della morte di Papa Francesco. Il giorno dopo si è però ritrovata al centro dell’attenzione per una fake news, e immagino che sia stata anche lei in difficoltà.

Quali conseguenze teme possano derivare da questo video, in generale anche per la fiducia del pubblico nei confronti dell’informazione?

Viviamo in un mondo in cui si fa fatica a credere a quella che è una notizia vera, data da tg o notiziari. Si mette tutto in discussione, perché ci sono i complottisti, le dietrologie e le seconde verità. In un momento del genere, è sempre importante avere dei punti di riferimento. Per chi fa il nostro lavoro, questo è un “colpo basso“, perché si rischia di finire in una situazione in cui viene minata la propria credibilità e bisogna quindi lottare ancora di più per avere la fiducia di chi ci ascolta, dei lettori e dei telespettatori. In questo momento, bisognerebbe dare più certezze alla popolazione per tutto quello che accade nel mondo.

L’esperto: “La battaglia contro la manipolazione digitale richiede una risposta collettiva”

TvBlog ha sentito Marco Marra, esperto di Cyber Security con molti anni di esperienza nella prevenzione e gestione delle minacce cibernetiche. Altamente qualificato grazie alla continua formazione tecnica ed alle innumerevoli collaborazioni su progetti di sicurezza di importanti dimensioni in contesti Italiani e internazionali, è impegnato in attività di hacking etico e nella progettazione di sistemi di difesa Cyber Fisici.

“I deepfake rappresentano una delle minacce digitali più insidiose del nostro tempo. Parliamo di contenuti audio e video generati o modificati attraverso intelligenza artificiale, in grado di imitare fedelmente volto, voce e movimenti di una persona reale. La loro diffusione crescente, spesso attraverso i social, mina la fiducia nel giornalismo e nella veridicità delle fonti visive. Non si tratta solo di una questione tecnologica, ma di un problema che tocca la reputazione, la sicurezza e la libertà d’espressione. Nel caso specifico che ha coinvolto la giornalista italiana Silvia Sacchi, vittima di un video artefatto volto a diffamarla, vediamo come queste tecnologie possano essere usate per scopi criminali. È fondamentale che il pubblico capisca che non tutto ciò che vede online è autentico.

Dal punto di vista della cybersecurity, oggi esistono strumenti avanzati per individuare i deepfake: algoritmi di rilevamento, software di analisi forense dei contenuti audiovisivi, e tecnologie di autenticazione come le firme digitali basate su blockchain o metadati. Tuttavia, la tecnologia da sola non basta. Occorre investire in formazione, per aumentare la consapevolezza e la capacità di riconoscere contenuti manipolati. Parallelamente, servono norme aggiornate, come l’AI Act europeo, e un impegno più forte da parte delle piattaforme digitali nel monitorare e rimuovere tempestivamente i deepfake dannosi. La battaglia contro la manipolazione digitale richiede una risposta collettiva: da parte dei professionisti dell’informazione, dei tecnologi, dei legislatori e, soprattutto, degli utenti, che devono essere formati a una fruizione critica dei contenuti online”.