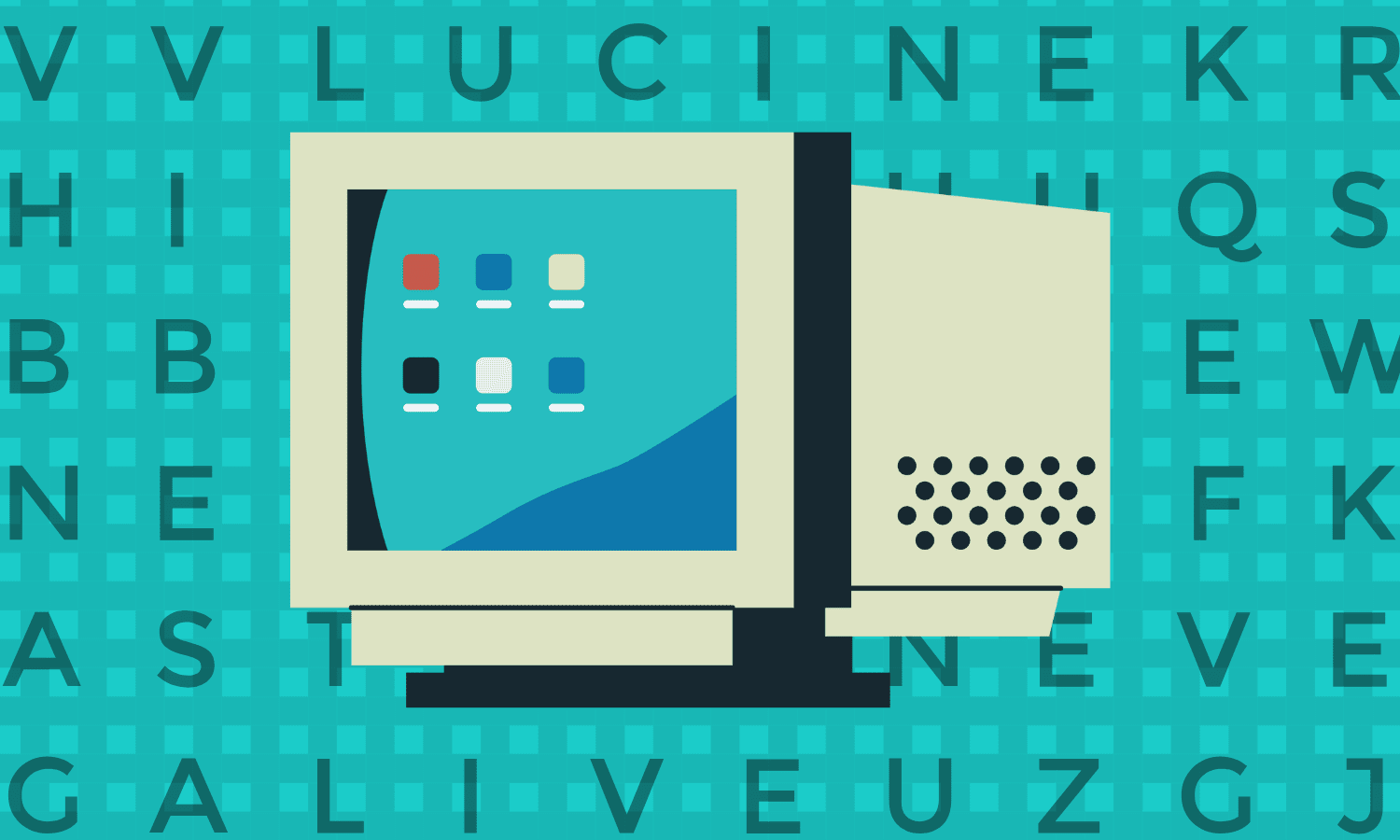

Uso de Modelos de Lenguaje de Gran Tamaño en Amazon Bedrock para la ejecución de tareas multi-paso

Un nuevo enfoque en la utilización de modelos de lenguaje de gran tamaño (LLM, por sus siglas en inglés) está […]

Un nuevo enfoque en la utilización de modelos de lenguaje de gran tamaño (LLM, por sus siglas en inglés) está revolucionando la manera en que se llevan a cabo tareas analíticas complejas en el sector de la salud. Tradicionalmente, responder a preguntas como «¿Cuál es la duración promedio de estancia de los pacientes con una condición específica en diferentes hospitales?» requería el tiempo y la experiencia de especialistas en inteligencia empresarial y de ingenieros de datos. Esto a menudo resultaba en procesos prolongados y cuellos de botella en la obtención de información.

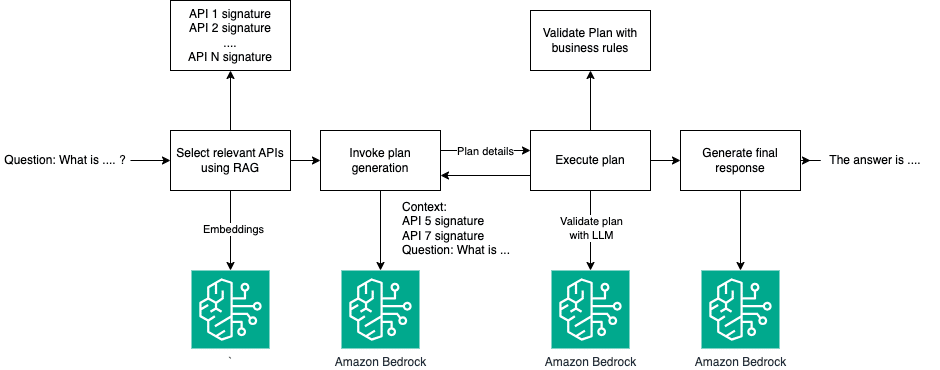

Sin embargo, los recientes avances en los LLM han abierto nuevas posibilidades que permiten desglosar tareas complicadas en varios pasos, utilizando herramientas que facilitan la ejecución de cada fase y la producción de soluciones finales. En este contexto, el término «herramientas» se refiere a capacidades o APIs externas que el modelo puede acceder e interactuar con, ampliando su funcionalidad más allá de las respuestas textuales. Estas herramientas permiten a los LLM realizar tareas especializadas, como recuperar información en tiempo real, ejecutar código o generar imágenes, lo que mejora la precisión y la relevancia de las respuestas.

Un ejemplo significativo de estas capacidades es la solución de recuperación de registros de pacientes, que se basa en un conjunto de datos existente y utiliza únicamente APIs, evitando la complejidad del enfoque de texto a SQL. Esta solución tiene como objetivo responder preguntas analíticas que requieren razonamiento y ejecución multicanal. Durante una interacción, un usuario podría solicitar el nombre y apellido del paciente con menos vacunas, y el sistema podría regresar con una respuesta precisa tras realizar una serie de pasos programáticos.

A través de la implementación de un proceso estructurado en dos etapas —planificación y ejecución— la solución logra ofrecer respuestas introduciendo la lógica necesaria para descomponer preguntas complejas en pasos más manejables. En la etapa de planificación, se proporcionan firmas de funciones API, que permiten al LLM formular un plan claro y lógico para responder a la consulta del usuario. Esta planificación se expresa en un formato estructurado JSON, lo que facilita su ejecución.

En la etapa de ejecución, este plan se lleva a cabo de manera programática, con cada llamada a funciones ejecutándose secuencialmente. La robustez del proceso se refuerza mediante mecanismos de manejo de errores que permiten detectar y resolver problemas potenciales durante la ejecución, garantizando resultados confiables y precisos.

Este enfoque demuestra cómo los LLM pueden ir más allá de ser simples generadores de texto, ofreciendo soluciones prácticas basadas en datos que pueden transformar significativamente los flujos de trabajo analíticos y la toma de decisiones en el ámbito empresarial.

.jfif)