Amazon Bedrock: Guardrails para Filtrar Contenido Dañino de Forma Efectiva

Amazon ha lanzado oficialmente los filtros de contenido de imagen en su plataforma Amazon Bedrock Guardrails, ampliando los mecanismos de […]

Amazon ha lanzado oficialmente los filtros de contenido de imagen en su plataforma Amazon Bedrock Guardrails, ampliando los mecanismos de moderación de contenido en aplicaciones de inteligencia artificial generativa. Hasta ahora, la moderación se limitaba al texto, pero con esta nueva funcionalidad, las capacidades de control se extienden a las imágenes, lo que facilita la gestión de los insumos y las respuestas generadas por la IA.

Tero Hottinen, Vicepresidente de Alianzas Estratégicas en KONE, ha valorado positivamente esta innovación, sugiriendo que Amazon Bedrock Guardrails podría ser crucial para proteger aplicaciones de IA generativa, en especial, en la verificación de la relevancia y el contexto. KONE proyecta integrar estos sistemas en sus aplicaciones, usando los guardrails para asegurar un mejor análisis y diagnóstico de contenido multimodal, como diagramas de diseño de productos y manuales.

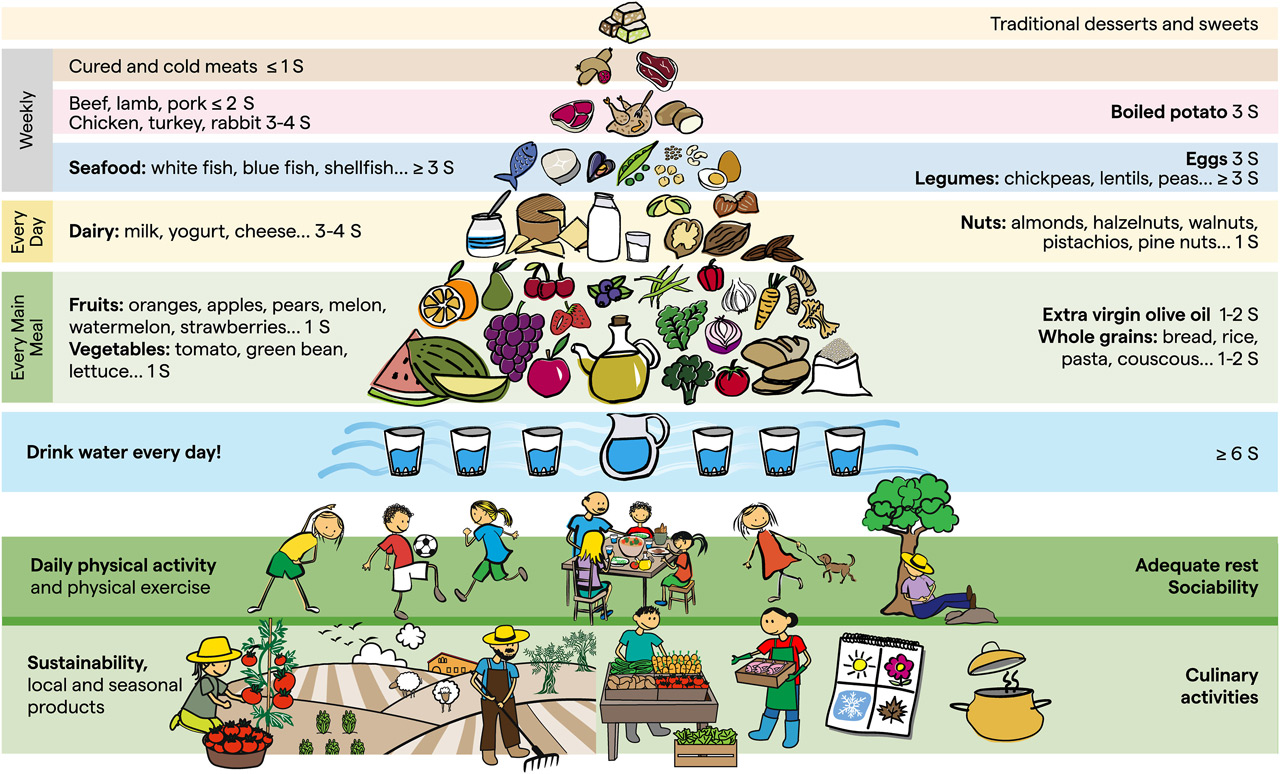

La herramienta permite a los usuarios establecer salvaguardias configurables que bloquean entradas y salidas perjudiciales. Las seis políticas diferentes que propone, desde filtros de contenido hasta la detección de alucinaciones del modelo, ayudan a eliminar hasta el 88% del contenido multimodal dañino. Ahora, los desarrolladores tienen la posibilidad de combinar la moderación de texto e imágenes y ajustar los umbrales de seguridad del contenido según sus necesidades.

Esta funcionalidad está disponible en varias regiones de AWS, incluyendo EEUU, Europa y Asia-Pacífico, y ofrece a sectores como el sanitario, manufacturero, financiero, mediático y educativo, una forma de mejorar la seguridad de marca. Todo esto sin necesidad de construir salvaguardias personalizadas ni realizar evaluaciones manuales propensas a errores.

Para usar estos nuevos filtros de contenido de imagen, los usuarios deben crear un guardrail en la consola de administración de AWS y configurar sus preferencias. Además, se puede utilizar el API independiente ApplyGuardrail para validar contenido en cualquier flujo de aplicación.

Este avance es un paso significativo hacia un uso más seguro y responsable de la inteligencia artificial, y ayuda a las organizaciones a construir aplicaciones que cumplan con las políticas de IA responsable establecidas.