¿Cómo fomentar una cultura de la integridad en la IA y el metaverso?

«Involucrar a la sociedad civil en el desarrollo y regulación de la Inteligencia Artificial y el metaverso es esencial para garantizar que estas tecnologías se alineen con los valores y necesidades de la comunidad», señala Pedro Mujica en la obra ‘Superhumanos’ (LID Editorial). La entrada ¿Cómo fomentar una cultura de la integridad en la IA y el metaverso? se publicó primero en Ethic.

La ética y la transparencia en la Inteligencia Artificial y el metaverso son pilares fundamentales para garantizar que el desarrollo y la implementación de estas tecnologías se realicen de manera responsable y equitativa. A medida que avanzamos hacia una sociedad cada vez más digitalizada, es crucial establecer marcos éticos que guíen estas innovaciones, asegurando que los beneficios se distribuyan de manera justa y que los riesgos se gestionen adecuadamente.

Fomentar una cultura de integridad en el desarrollo de IA y metaverso implica que los desarrolladores y creadores actúen con honestidad y transparencia en todas las etapas del proceso. Esto no solo incluye la fase de diseño y programación, sino también la implementación y el mantenimiento continuo de estas tecnologías. La integridad debe ser un valor central en las organizaciones que desarrollan IA y metaverso, promoviendo la creación de sistemas que respeten los derechos humanos y la dignidad de los usuarios. Por ejemplo, un equipo de desarrollo que trabaje en una nueva plataforma de metaverso debe asegurarse de que todas las decisiones de diseño consideren el bienestar de los usuarios, evitando prácticas que puedan ser invasivas o explotadoras.

Los desarrolladores de IA y creadores de contenido del metaverso deben asumir la responsabilidad de los efectos y consecuencias de sus creaciones

La responsabilidad de los desarrolladores y creadores es otro aspecto crucial. Los desarrolladores de IA y creadores de contenido del metaverso deben asumir la responsabilidad de los efectos y consecuencias de sus creaciones. Esto significa no solo cumplir las normativas vigentes, sino también anticipar y mitigar posibles impactos negativos. Por ejemplo, los desarrolladores de una IA de recomendación deben ser conscientes de cómo sus algoritmos podrían influir en el comportamiento de los usuarios y trabajar para minimizar cualquier sesgo que pudiera surgir. De igual manera, los creadores de experiencias en el metaverso deben ser responsables de garantizar que sus entornos virtuales no promuevan comportamientos nocivos o adictivos.

La transparencia en las pruebas y evaluaciones de sistemas de IA y plataformas del metaverso es fundamental para mantener la confianza del público. Publicar los resultados de estas evaluaciones, incluyendo tanto los éxitos como los fracasos, ayuda a crear un entorno de transparencia y permite a otros aprender de estas experiencias. Por ejemplo, una empresa que desarrolla una nueva IA para diagnóstico médico podría publicar sus resultados de pruebas clínicas, detallando no solo los casos en los que la IA tuvo éxito, sino también aquellos en los que falló, y explicando las razones detrás de estos fallos. Esto no solo fomenta la confianza pública, sino que también contribuye al avance del conocimiento en el campo.

Involucrar a la sociedad civil en el desarrollo y regulación de la IA y el metaverso es esencial para garantizar que estas tecnologías se alineen con los valores y necesidades de la comunidad. Esto puede lograrse mediante consultas públicas, encuestas y la inclusión de representantes de diversas comunidades en los procesos de toma de decisiones. Por ejemplo, al desarrollar una nueva política para regular el uso de IA en la educación, los legisladores podrían realizar consultas con profesores, padres, estudiantes y expertos en ética para asegurarse de que la política refleje una amplia gama de perspectivas y preocupaciones. Esta participación no solo enriquece el proceso de toma de decisiones, sino que también ayuda a construir un sentido de propiedad y compromiso con las políticas resultantes.

Integrar principios éticos en los algoritmos de toma de decisiones automatizadas es vital para evitar resultados perjudiciales o discriminatorios. Los algoritmos deben ser diseñados de manera que respeten los derechos de los individuos y promuevan la justicia social. Por ejemplo, una IA utilizada para evaluar solicitudes de empleo debe ser cuidadosamente diseñada para evitar cualquier forma de discriminación basada en género, raza o cualquier otra característica protegida. Esto puede implicar la implementación de procesos de auditoría regulares para identificar y corregir cualquier sesgo que pueda surgir en el algoritmo.

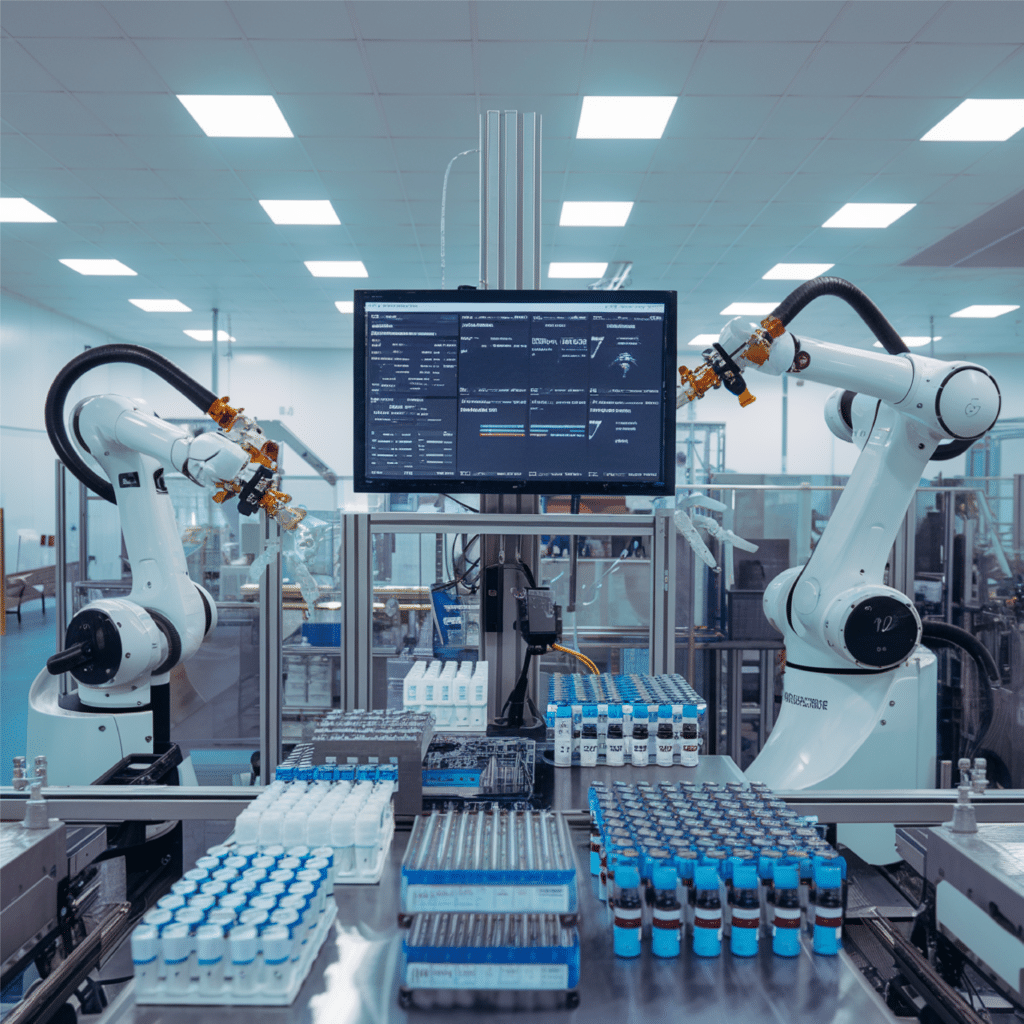

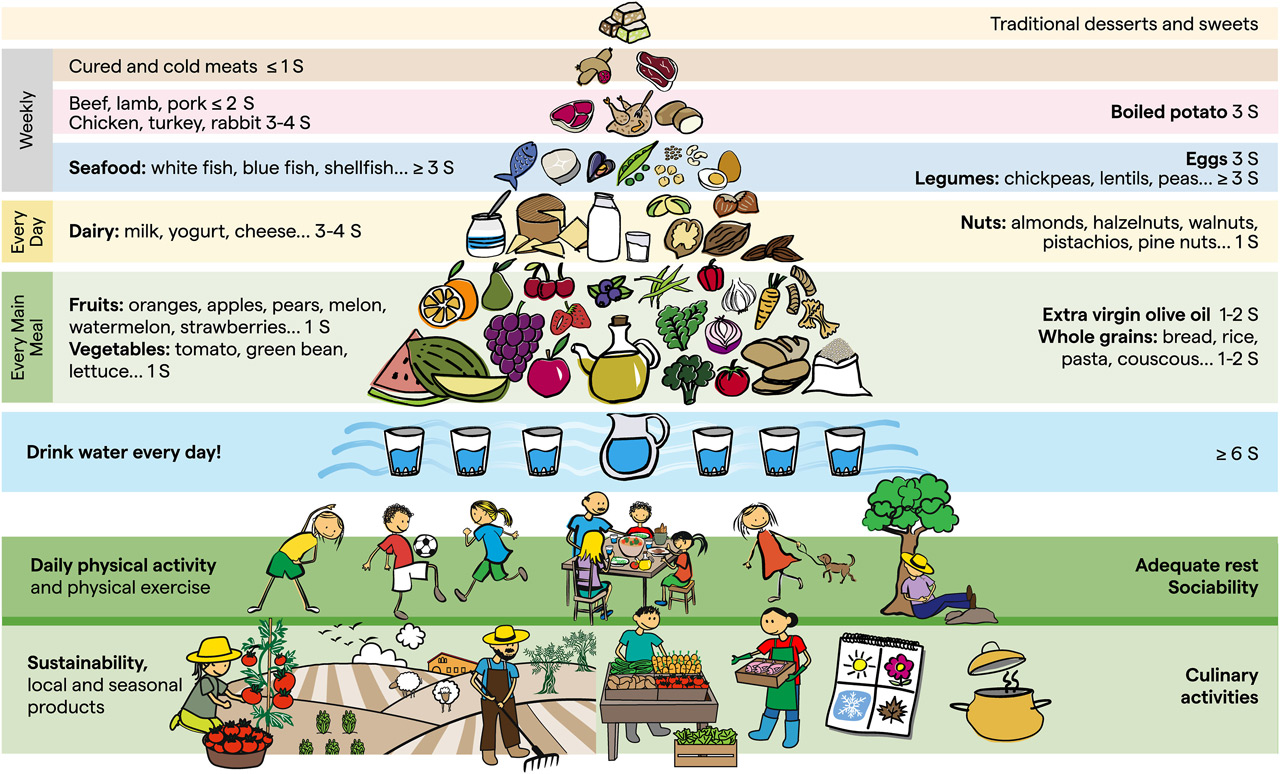

Promover prácticas de desarrollo tecnológico que minimicen el impacto ambiental es otro aspecto crucial de la ética en la IA y el metaverso. La sostenibilidad debe ser una consideración clave en el desarrollo de nuevas tecnologías, asegurando que el progreso no se logre a expensas del medioambiente. Por ejemplo, una empresa que desarrolla centros de datos para soportar aplicaciones de IA y metaverso podría invertir en energías renovables y tecnologías de eficiencia energética para reducir su huella de carbono. Esto no solo beneficia el medioambiente, sino que también puede mejorar la reputación de la empresa y atraer a consumidores conscientes del medioambiente.

Este texto es un fragmento de ‘Superhumanos. Cómo empoderar a las personas mediante la inteligencia artificial y el metaverso’ (LID Editorial), de Pedro Mujica.

La entrada ¿Cómo fomentar una cultura de la integridad en la IA y el metaverso? se publicó primero en Ethic.